티스토리 뷰

목차

활성화 함수(Activation Functions) 이해하기

손실 함수(Loss Functions)의 역할과 중요성

확률적 경사 하강법(Stochastic Gradient Descent, SGD)

합성곱 신경망(Convolutional Neural Network, CNN)

순환 신경망(Recurrent Neural Network, RNN)

순환 신경망의 발전(The Evolution of RNN)

Introduction

딥러닝의 발전에서 순환 신경망(Recurrent Neural Network, RNN)은 놀라운 발전을 가져왔다.

이 게시글에서는 RNN의 개념부터 활용까지, 그 개념을 가볍게 알아보자.

Recurrent Neural Network, RNN

순환 신경망이란 무엇인가? 이 질문에 답하기 위해 먼저 인공 신경망의 기본 구조를 살펴볼 필요가 있다.

인공 신경망(ANN: Artificial Neural Network)은 데이터를 처리하고 학습하는 알고리즘의 집합으로,

뇌의 신경망에서 영감을 받아 개발되었다.

일반적인 ANN은 입력(input)에서 출력(output)으로 단방향으로 데이터가 흐른다.

그러나, 순환 신경망(RNN)은 다르다. RNN은 과거의 정보를 저장하고 이를 바탕으로 현재의 출력을 결정한다.

이는 시간적 순서가 중요한 데이터를 처리할 때 유리하며, 언어 번역이나 주가 예측 같은 복잡한 작업에 매우 적합하다.

ANN vs RNN

기본적인 ANN은 'One to One' 구조를 가진다.

이는 하나의 입력이 들어가면 하나의 출력이 나오는 단순한 구조를 말한다.

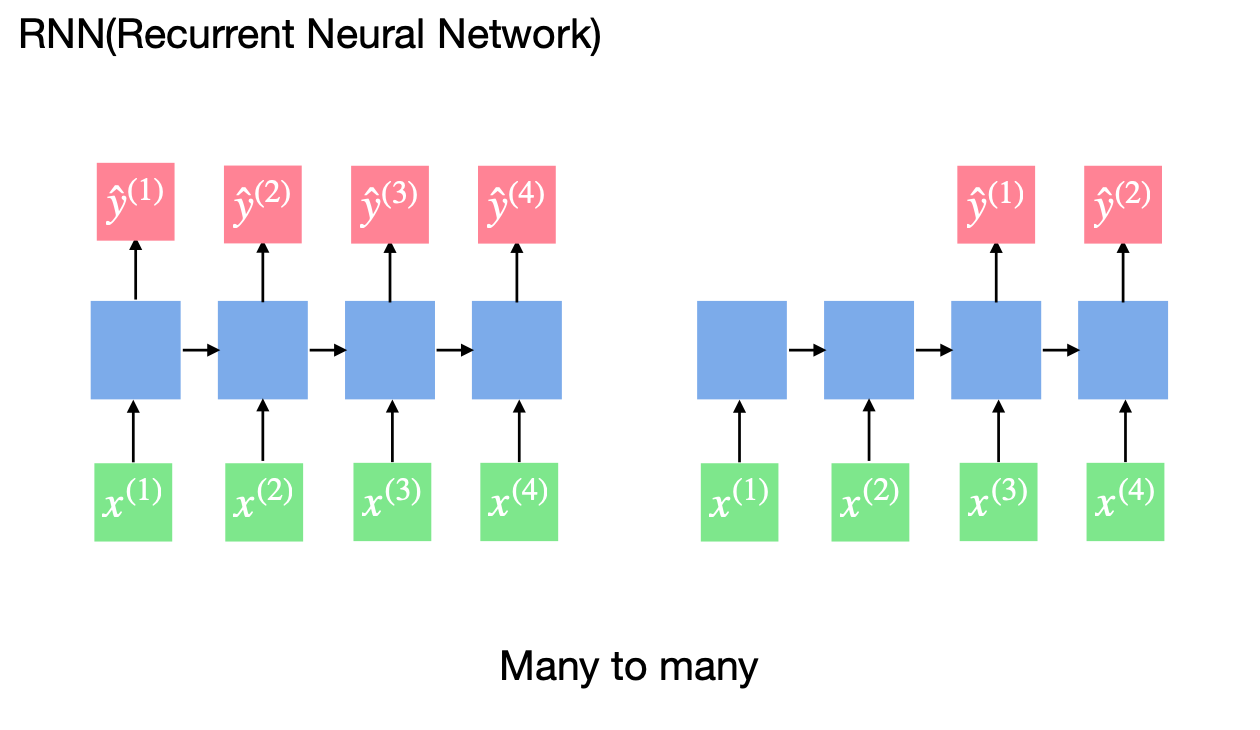

반면, RNN은 입력과 출력의 관계가 'One to Many', 'Many to One', 'Many to Many' 등으로 다양하게 나타날 수 있다.

'One to Many'는 한 번의 입력으로 여러 개의 출력을 내는 것을 의미한다.

예를 들어, 하나의 이미지로부터 그 이미지에 대한 여러 문장의 설명을 생성하는 경우가 이에 해당한다.

'Many to One'은 여러 시간 단계의 입력으로부터 하나의 출력을 생성하는 것을 의미한다.

감정 분석이나 주제 분류 등이 이에 해당한다.

마지막으로, 'Many to Many'는 번역이나 시계열 예측과 같이 입력과 출력이 시퀀스 형태로 주어지는 경우이다.

Applications of RNN

순환 신경망은 다양한 분야에서 활용된다.

언어 번역에서는 하나의 언어로 된 문장을 다른 언어로 변환하는 데 쓰인다.

신호 처리에서는 음성이나 음악 신호를 인식하고 처리하는 데 사용된다.

주가 예측에서는 과거의 가격 변동성을 학습하여 미래의 주가를 예측한다.

음성 인식에서는 사람의 음성을 텍스트로 변환하는 기술에 필수적이다.

Vanilla RNN

'Vanilla RNN'이란 가장 기본적인 형태의 RNN을 말한다. 이 모델은 다음과 같은 수식으로 표현된다:

$h^{(t)}=tanh(a^{(t)})$

$a^{(t)}=b+Wh^{(t−1)}+Ux^{(t)}$

$y^{(t)}=softmax(o^{(t)})$

$o^{(t)}=c+Vh^{(t)}$

x(t)는 시간 t에서의 입력, h(t)는 은닉 상태(hidden state), y(t)는 출력이다.

이어서 W, U, V는 모델이 학습해야 할 가중치이다. 은닉 상태 h(t)는 과거의 모든 정보를 압축하여

현재의 출력과 다음 시간 단계의 입력에 영향을 준다.

Loss Functions in RNN

RNN의 학습 과정에서는 손실함수를 이용해 모델의 성능을 평가하고 이를 통해 모델을 개선한다.

대표적인 손실 함수로는 'Cross-Entropy'와 'MSE(Mean Squared Error)'가 있다.

Cross-Entropy는 실제 값과 예측 값 사이의 확률 분포 차이를 측정하는데 적합하며, 주로 분류 문제에 사용된다.

MSE는 예측 값과 실제 값 사이의 거리를 제곱한 값의 평균으로, 회귀 문제에 주로 사용된다.

손실 함수의 값이 작을수록 모델의 예측이 실제 데이터에 가깝다는 것을 의미한다.

RNN에서는 시간에 따라 출력값의 차이를 누적하여 손실을 계산한다.

Additional Insights

순환 신경망은 그 독특한 구조 때문에 일반적인 신경망과는 다른 특징을 가진다.

RNN은 '메모리'를 가지고 있다고 볼 수 있는데,

이는 은닉층의 상태가 다음 시간 단계의 입력과 현재의 출력에 영향을 미친다는 것을 의미한다.

이 특성 덕분에, RNN은 시계열 데이터나 자연어와 같이 순차적인 정보를 다루는 데 매우 강력하다.

그러나 RNN은 '장기 의존성 문제(Long-Term Dependencies Problem)'라는 한계를 가지고 있다.

이는 RNN이 오래된 정보를 장기간 기억하는 데 어려움을 가질 수 있다는 것을 의미한다.

이를 극복하기 위해 'LSTM(Long Short-Term Memory)'나 'GRU(Gated Recurrent Unit)'과 같은

더 발전된 RNN 구조들이 개발되었다.

Conclusion

순환 신경망은 시간적 데이터를 이해하고 예측하는 데 필수적인 도구이다.

그 유연성과 강력한 기능으로 인해 번역, 주식 예측, 음성 인식 등 다양한 분야에서 널리 사용되고 있다.

이러한 기술의 발전은 우리가 일상에서 경험하는 많은 서비스의 질을 향상하는 데 크게 기여하고 있다.

하지만 기술은 끊임없이 발전하고 있으며, RNN 또한 더욱 진화할 것이다.

연구자들은 모델의 한계를 극복하고, 성능을 향상하기 위해 계속해서 새로운 아키텍처를 탐구하고 있다.

'ML+DL > Deep Learning' 카테고리의 다른 글

| 생성적 적대 신경망(Generative Adversarial Network, GAN) (0) | 2024.04.11 |

|---|---|

| 오토 인코더(Autoencoder) (0) | 2024.04.11 |

| 순환 신경망의 발전(The Evolution of RNN) (0) | 2024.04.10 |

| 합성곱 신경망(Convolutional Neural Network, CNN) (0) | 2024.04.07 |

| 합성곱 연산(Convolution) (0) | 2024.04.05 |

| 컴퓨터 비전(Computer Vision) (0) | 2024.04.04 |

- Total

- Today

- Yesterday

- 유럽여행

- Algorithm

- 알고리즘

- 맛집

- BOJ

- 지지

- 칼이사

- 세모

- 남미

- 세계일주

- 동적계획법

- 백준

- 파이썬

- 여행

- 자바

- Backjoon

- 야경

- 기술면접

- 면접 준비

- 중남미

- spring

- 리스트

- java

- a6000

- 세계여행

- 스프링

- RX100M5

- 유럽

- 스트림

- Python

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | |||

| 5 | 6 | 7 | 8 | 9 | 10 | 11 |

| 12 | 13 | 14 | 15 | 16 | 17 | 18 |

| 19 | 20 | 21 | 22 | 23 | 24 | 25 |

| 26 | 27 | 28 | 29 | 30 | 31 |