티스토리 뷰

Chapter 2: Introduction to probability

Vagabund.Gni 2025. 3. 21. 19:10목차

이 챕터에서는 확률론의 핵심 개념을 간략히 정리한다.

개념의 수는 많지 않으며, 각각을 개별적으로 보면 비교적 단순하다.

그러나 이 개념들이 결합되면 불확실성을 기술하는 강력한 언어가 된다.

2.1 확률 변수

확률 변수 $x$는 불확실한 양을 나타낸다.

이는 동전을 던지는 실험의 결과처럼 특정 실험의 결과일 수도 있고,

온도 측정과 같이 변동하는 물리적 속성을 측정한 값일 수도 있다.

동일한 실험을 여러 번 반복하여 $\{x_i\}^{I}_{i=1}$와 같은 관측값을 얻으면, 각 시행에서 서로 다른 값이 나올 수 있다.

그러나 특정 값이 더 자주 나타날 수도 있다. 이러한 정보를 확률 분포 $Pr(x)$가 표현한다.

확률 변수는 이산형(discrete) 또는 연속형(continuous) 일 수 있다.

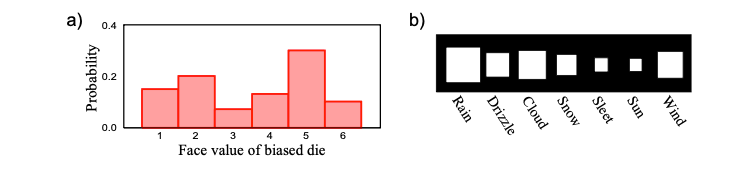

- 이산 확률 변수는 미리 정의된 값들 중 하나를 취한다.

이 값들은 순서가 있을 수도 있고(예: 주사위를 던졌을 때 나오는 값 1–6),

순서가 없을 수도 있다(예: 날씨가 ‘맑음’, ‘비’, ‘눈’ 중 하나일 때).

또한, 가능한 값의 개수가 유한할 수도 있고(예: 52장의 카드 중 하나를 뽑는 경우),

무한할 수도 있다(예: 다음 기차에 탈 사람의 수는 이론적으로 무한 가능). - 이산 확률 변수의 확률 분포는 히스토그램이나 힌튼 다이어그램(Hinton diagram)으로 시각화할 수 있다 (그림 2.1).

모든 가능한 결과는 0 이상의 확률을 가지며, 전체 확률의 합은 항상 1이다.

- 연속 확률 변수는 실수 값을 가진다.

- 값이 유한한 경우: 시험을 치르는 데 걸리는 시간이 0시간에서 2시간 사이일 때.

- 값이 무한한 경우: 다음 버스가 도착할 때까지 걸리는 시간은 상한이 없다.

- 일부 연속 변수는 실수 전체 범위에서 정의될 수도 있고, 상한이나 하한이 존재할 수도 있다(예: 자동차의 속도는 0 이상이지만 음수가 될 수 없다).

- 연속 확률 변수의 확률 분포는 확률 밀도 함수(probability density function, pdf)로 표현된다 (그림 2.2).

- 확률 밀도 함수 값은 특정 값이 발생할 상대적 가능성을 나타낸다.

- 확률 밀도 함수의 값 자체는 1을 초과할 수도 있다.

- 하지만 확률 밀도 함수의 적분 값(곡선 아래 면적)은 항상 1이어야 한다.

확률 밀도 함수(Probability Density Function, pdf)

확률 밀도 함수(Probability Density Function, pdf)

목차 생각해 보면 대학원을 다닐 때도 pdf의 의미에 대해선 크게 관심이 없었다. 그냥 이런저런 성질을 가지고 있고 이렇게 쓴다.. 쓰면 되지 뭐.. 하고 썼는데 10년이나 넘게 지나 다시 마주친

gnidinger.tistory.com

2.2 결합 확률 (Joint Probability)

두 개의 확률 변수 $x$와 $y$를 고려하자. 여러 쌍의 $x$와 $y$를 관측하면,

특정 조합이 다른 조합보다 더 자주 발생하는 경향이 있다. 이러한 정보를 포함하는 것이 바로

$x$와 $y$ 의 결합 확률 분포(joint probability distribution)이며, 이는

$$Pr(x,y)$$

로 표기된다. 여기서 쉼표는 영어에서 "and"로 해석할 수 있으므로, $Pr(x,y)$는

"$x$와 $y$가 동시에 발생할 확률"을 의미한다.

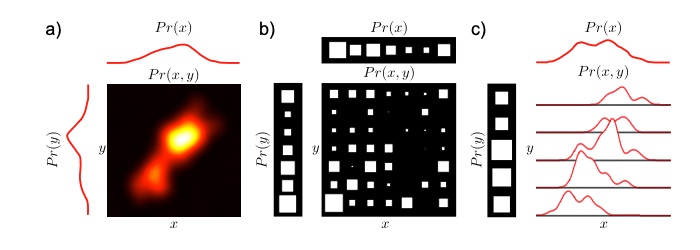

결합 확률 분포는 모든 변수가 이산(discrete)인 경우, 모든 변수가 연속(continuous)인 경우,

혹은 이산 변수와 연속 변수가 혼합된 경우에도 적용될 수 있다(그림 2.3 참조).

중요한 점은, 모든 가능한 결과의 확률을 합산(이산 변수의 경우)하거나

적분(연속 변수의 경우)하면 항상 1이 되어야 한다는 것이다.

보다 일반적으로, 두 개 이상의 변수에 대한 결합 확률 분포를 고려하는 경우가 많다.

이를 표현하기 위해 $x$, $y$, $z$가 스칼라 변수하면, $Pr(x,y,z)$는 이 세 변수의 결합 확률 분포를 의미한다.

또한, 다차원 변수 $x = [x_1, x_2, ..., x_k]^{T}$에 대해 $Pr(x)$는 모든 요소의 결합 확률을 나타낸다.

마찬가지로 $x$와 $y$가 다차원 변수라면 $Pr(x)$는 두 변수의 모든 요소 간 결합 분포를 의미한다.

참고로 여기서 $x = [x_1, x_2, ..., x_k]^{T}$는 별 게 아니고 열 벡터 형태로 표현된 변수를 가리킨다.

2.3 주변화 (Marginalization)

어떤 확률변수의 확률 분포를 공동 확률 분포(joint distribution)로부터 복원할 수 있다.

이를 위해 다른 모든 변수에 대해 합(discrete case) 또는 적분(continuous case)을 수행한다(그림 2.4).

예를 들어 $x$와 $y$가모두 연속형 변수이고, $Pr(x,y)$를 알고 있다고 하자.

그러면 다음과 같은 관계식을 이용하여 $Pr(x)$와 $Pr(y)$를 구할 수 있다.

$$\begin{align*} Pr(x)=\int Pr(x,y) dy \\ Pr(y)=\int Pr(x,y) dx \end{align*}\tag{2.1}$$

이렇게 얻어진 $Pr(x)$와 $Pr(y)$를 주변 확률 분포(marginal distribution)라고 하며,

다른 변수에 대해 적분하거나 합을 수행하는 과정을 주변화(marginalization)라고 한다.

공동 확률 분포 $Pr(x,y)$로부터 변수 $y$를 주변화하여 $Pr(x)$를 계산하는 것은 직관적으로 다음과 같이 해석할 수 있다:

변수 $y$의 값에 대한 정보 없이 x의 확률 분포를 구하는 과정이다.

즉, $Pr(x,y)$는 $x$와 $y$가 함께 나타날 확률을 나타내지만, 만약 $y$에 대한 정보가 필요하지 않다면,

가능한 모든 $y$의 경우에 대해 $Pr(x,y)$를 합산(혹은 적분)하여 "순수한" $x$의 확률 분포 $Pr(x)$를 얻을 수 있다.

이는 마치 한 도시에서 특정 직업을 가진 사람들의 수를 알고 싶을 때

성별에 대한 정보를 무시하고 직업별로 합산하는 것과 같은 개념이며,

수학적으로 보면 확률 공간의 차원을 줄여 특정 변수에 집중하는 과정이라 볼 수 있다.

보다 일반적으로, 어떤 변수 집합의 공동 확률 분포를 복원하고자 할 때, 다른 모든 변수에 대해 주변화를 수행할 수 있다.

예를 들어, 변수 $w$, $x$, $y$, $z$가 주어졌을 때, $w$가 이산형 변수이고 z가 연속형 변수라고 가정하자.

그러면 $Pr(x,y)$는 다음과 같이 주변화하여 얻을 수 있다.

$$Pr(x,y)=\sum_{w}\int Pr(w,x,y,z) dz \tag{2.2}$$

2.4 조건부 확률

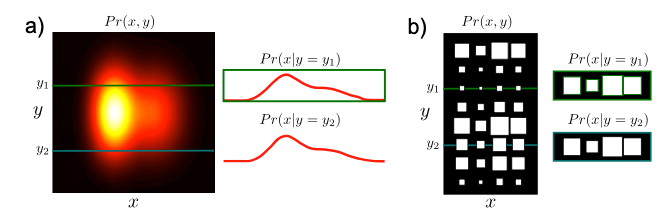

어떤 확률 변수 $x$가 다양한 값을 가질 가능성을, 다른 확률 변수 $y$가 특정한 값

$y^*$를 가질 때의 조건하에서 살펴보는 것이 조건부확률(conditional probability)이다.

이는 $Pr(x|y=y^*)$로 표기하며, 기호 "$|$"는 "given"이라는 의미로 해석할 수 있다.

조건부 확률 $Pr(x|y=y^*)$는 결합 확률 분포(joint distribution) $Pr(x,y)$에서 얻을 수 있다.

이를 위해, 결합 분포에서 특정 값 $y=y^*$에 해당하는 슬라이스(slice) $Pr(x,y=y^*)$을 살펴본다(그림 2.5).

이 슬라이스의 값들은 주어진 $y=y^*$에 대해 $x$가 다양한 값을 가질 상대적인 가능성을 제공하지만,

자체적으로 정규화된 확률 분포를 형성하지는 않는다.

즉, 원래 결합 확률 분포는 모든 가능한 $x$, $y$에 대해 합이 1이 되지만, 슬라이스만 따로 보면 합이 1이 되지 않는다.

이를 정규화하여 올바른 확률 분포를 얻기 위해, 슬라이스 내 총 확률로 나누어 준다:

$$Pr(x|y=y^*) = \frac{Pr(x,y=y^*)}{\int Pr(x,y=y^*)dx} = \frac{Pr(x,y=y^*)}{Pr(y=y^*)} \tag{2.3}$$

위 식에서 주변 확률(marginal probability) 관계식(식 2.1)을 사용하여 분모를 단순화했다.

보다 일반적인 표기법으로, 특정 값 $y=y^*$를 명시적으로 정의하지 않고 간단하게 쓰면:

$$Pr(x|y) = \frac{Pr(x,y)}{Pr(y)} \tag{2.4}$$

이 관계식은 다음과 같이 변형할 수도 있다:

$$Pr(x,y) = Pr(x|y)Pr(y) \tag{2.5}$$

또한 이는 대칭적으로 다음과 같은 식도 성립함을 의미한다.

$$Pr(x,y) = Pr(y|x)Pr(x) \tag{2.6}$$

두 개 이상의 확률 변수를 다룰 때, 조건부 확률을 반복적으로 사용하여

결합 확률을 여러 개의 개별적인 확률 요소들의 곱으로 분해할 수 있다:

$$\begin{align*} Pr(w,x,y,z) &= Pr(w,x,y|z)Pr(z) \\ &= Pr(w,x|y,z)Pr(y|z)Pr(z) \\ &= Pr(w|x,y,z)Pr(x|y,z)Pr(y|z)Pr(z) \end{align*}\tag{2.7}$$

이러한 방식으로 다변수 확률 분포를 여러 개의 조건부 확률 분포의 곱으로 표현할 수 있다.

수학적 증명

위 식은 조건부 확률에도 체인 룰이 적용된다는 것을 뜻한다.

당연하게 받아들일 수도 있지만, 나처럼 중간 과정이 이해 안 가는 사람을 위해 간단한 증명을 적어보겠다.

우선, 조건부 확률의 정의에 따라 다음 두 식이 성립한다:

$$Pr(A|B,C)=\frac{Pr(A,B,C)}{Pr(B,C)} \\ Pr(B|C)=\frac{Pr(B,C)}{Pr(C)}$$

이어서 두 식을 곱하면 다음과 같은 결과를 얻는데:

$$Pr(A|B,C)Pr(B|C)=\frac{Pr(A,B,C)}{Pr(B,C)}\frac{Pr(B,C)}{Pr(C)}=\frac{Pr(A,B,C)}{Pr(C)}$$

여기서 조건부 확률의 정의를 다시 사용하면 다음과 같다:

$$\frac{Pr(A,B,C)}{Pr(C)}=Pr(A,B|C)$$

마지막으로 끝과 처음을 이으면 다음과 같이 증명이 끝난다:

$$Pr(A,B|C)=Pr(A|B,C)Pr(B|C)$$

2.5 베이즈 정리 (Bayes’ rule)

식 (2.5)와 (2.6)에서는 결합 확률(joint probability)을 두 가지 방식으로 표현했다.

이 두 표현을 결합하면 $Pr(x|y)$와 $Pr(y|x)$사이의 관계를 다음과 같이 유도할 수 있다:

$$Pr(y|x)Pr(x)=Pr(x|y)Pr(y)\tag{2.8}$$

이를 정리하면 다음과 같은 식이 얻어진다:

$$\begin{align*}Pr(y|x) &= \frac{Pr(x|y)Pr(y)}{Pr(x)} \\ &= \frac{Pr(x|y)Pr(y)}{\int Pr(x,y) dy} \\ &= \frac{Pr(x|y)Pr(y)}{\int Pr(x|y)Pr(y) dy} \end{align*}\tag{2.9}$$

여기서 두 번째와 세 번째 식은 각각 주변 확률(marginal probability)과 조건부 확률의 정의를 이용해 분모를 확장한 것이다.

이 세 식은 모두 베이즈 정리라고 불린다.

베이즈 정리에 등장하는 각 항은 고유한 이름을 가진다.

좌변의 $Pr(y|x)$는 사후 확률(posterior)이라 하며, 관측값 $x$를 고려한 후 변수 $y$에 대해 아는 바를 나타낸다.

반대로 $Pr(y)$는 사전 확률(prior)이라 하며,$x$를 관측하기 전에 $y$에 대해 알고 있는 정보를 나타낸다.

$Pr(x|y)$는 우도(likelihood)라 불리며, $Pr(x)$는 증거(evidence)라고 한다.

컴퓨터 비전에서는 일반적으로 변수 $x$와 $y$의 관계를 조건부 확률$Pr(x|y)$로 모델링한다.

그러나 실제로는 변수 $y$에 더 관심이 있는 경우가 많으며, 이때 베이즈 정리를 이용하여 $Pr(y|x)$를 계산하게 된다.

베이즈 정리는 매우 중요한 개념이기 때문에, 글을 분리해서 공부해 보았다.

베이즈 정리(Bayes' theorem)

목차 베이즈 정리? 베이즈 정리란, 나무위키에 따르면 다음과 같은 정의를 가지고 있다. 어떤 사건이 서로 배반하는 원인 둘에 의해 일어난다고 할 때, 실제 사건이 일어난 후 그것이 두 원인

gnidinger.tistory.com

2.6 독립성 (Independence)

어떤 변수 $x$의 값을 알아도 변수 $y$에 대해 아무런 정보도 얻을 수 없고, 그 반대도 마찬가지일 경우,

두 변수 $x$와 $y$는 독립(independent)이라고 한다 (그림 2.6 참조).

이 경우 다음과 같이 쓸 수 있다.

$$\begin{align*}Pr(x|y) = Pr(x) \\ Pr(y|x) = Pr(y)\end{align*} \tag{2.10}$$

이 식을 식 (2.5)에 대입하면, 독립적인 변수의 경우 결합 확률 $Pr(x,y)$는

주변확률 $Pr(x)$와 $Pr(y)$의 곱으로 표현된다는 것을 알 수 있다.

$$Pr(x,y) = Pr(y|x)Pr(y) = Pr(x)Pr(y) \tag{2.11}$$

이는 직관적으로도 자연스럽다. 어떤 사건 $y$가 일어났는지 여부가 사건 $x$의 발생 확률에 영향을 주지 않기 때문에,

두 사건의 동시 발생 확률은 각 사건이 독립적으로 발생할 확률의 곱으로 계산할 수 있다.

독립성은 확률 모델링에서 변수 간의 관계를 단순화하는 데 핵심적인 역할을 한다.

기댓값 (Expectation)

확률 변수 $x$가 가질 수 있는 각 값 $x^*$에 대해 어떤 함수 $f[⋅]$가 값을 반환하고,

각 $x$가 발생할 확률 $Pr(x=x^*)$가 주어졌을 때, 함수의 출력값에 대한 기댓값을 계산하고자 하는 경우가 있다.

확률 분포로부터 매우 많은 수의 샘플을 추출하고, 각 샘플에 대해 함수를 적용한 뒤,

이 값들의 평균을 구하면 그것이 바로 기댓값이다.

보다 정확하게, 확률 변수 $x$의 함수 $f[⋅]$에 대한 기댓값은 다음과 같이 정의된다:

$$\begin{align*}E[f[x]]=\sum_xf[x]Pr(x), \\ E[f[x]]=\int f[x]Pr(x)dx\end{align*} \tag{2.12}$$

이 개념은 다변량 확률 변수로도 확장된다. 예를 들어, 두 확률 변수 $x$와 $y$에 대한 함수

$f[x,y]$의 기댓값은 다음과 같다:

$$E[f[x,y]]=\int\int f[x,y]Pr(x,y)dxdy\tag{2.13}$$

일부 함수 $f[⋅]$에 대해서는 기댓값에 특별한 명칭이 붙는다.

<표 2.1>에 나열된 이러한 값들은 복잡한 확률 분포의 특성을 요약하는 데 자주 사용된다.

| 함수 $f[⋅]$ | 기댓값의 명칭 |

| $x$ | 평균 (mean, $\mu_x$) |

| $x^k$ | 0 기준 k차 모멘트($k^{th}$ moment about zero) |

| $(x-\mu_x)^k$ | 평균 기준 k차 모멘트($k^{th}$ moment about the mean) |

| $(x-\mu_x)^2$ | 분산(variance) |

| $(x-\mu_x)^3$ | 왜도(skew) |

| $(x-\mu_x)^4$ | 첨도(kurtosis) |

| $(x-\mu_x)(y-\mu_y)$ | $x$와 $y$의 공분산(covariance) |

<표 2.1> 특정 함수 $f(x)$에 대해 기댓값$E[f(x)]$에는 특별한 명칭이 부여된다.

이 표에서는 확률 변수 $x$에 대한 평균을 $\mu_x$, 확률 변수 $y$에 대한 평균을 $\mu_y$로 표기하였다.

이러한 기댓값은 확률 분포의 중심 경향성, 산포도, 비대칭성 등을 정량적으로 설명하는 데 사용된다.

기댓값(expectation)에 대하여

목차 기댓값(expectation)은 확률론에서 매우 중요한 개념이고, 가장 자주 등장하는 개념이다.사실 다소 뻔한 개념이기는 한데, 그래도 오랜만에 만났으니 만난 김에 짧게 정리하고 가기로. 1. 기

gnidinger.tistory.com

기댓값의 네 가지 기본 성질

아래 네 가지 성질은 식 (2.12)로부터 쉽게 증명 가능하다:

1. 상수의 기댓값은 상수 그 자체이다:

$$E[\kappa] = \kappa \tag{2.14}$$

2. 상수와 함수의 곱의 기댓값은 상수를 밖으로 뺄 수 있다:

$$E[\kappa f[x]] = \kappa E[f[x]] \tag{2.15}$$

3. 두 함수의 합의 기댓값은 각각의 기대값의 합과 같다:

$$E[f[x]+g[x]] = E[f[x]]+E[g[x]] \tag{2.16}$$

4. 두 확률 변수 $x$, $y$가 독립일 때, 두 함수의 곱의 기댓값은 개별 기댓값의 곱과 같다:

$$E[f[x]g[x]] = E[f[x]]⋅E[g[x]] \tag{2.17}$$

Discussion

확률의 규칙들은 놀라울 정도로 간결하고 단순하다.

주변화(marginalization), 결합 확률(joint probability), 조건부 확률(conditional probability), 독립성(independence),

그리고 베이즈 정리(Bayes’ rule)는 이 책에서 다룰 모든 머신 비전 알고리즘의 기반을 이룬다.

여기서 마지막으로 다뤄야 할 중요한 개념이 하나 남아 있는데, 그것은 조건부 독립성(conditional independence)이다.

이 개념은 10장에서 자세히 논의한다.

'ML+DL > Computer Vision By Simon J.D. Prince' 카테고리의 다른 글

| 감마 함수 (Gamma Function) (1) | 2025.03.26 |

|---|---|

| 확률 모델의 불확실성? 베이지안 관점에서의 하이퍼파라미터 (0) | 2025.03.25 |

| 확률 밀도 함수(Probability Density Function, pdf) (0) | 2025.03.25 |

| 베이즈 정리(Bayes' theorem) (0) | 2025.03.21 |

| Part I: Probability (0) | 2025.03.19 |

| Chapter 1: Introduction (0) | 2025.03.19 |

- Total

- Today

- Yesterday

- 동적계획법

- java

- Algorithm

- 파이썬

- 여행

- 세계일주

- 면접 준비

- 칼이사

- 중남미

- BOJ

- spring

- RX100M5

- 스트림

- Backjoon

- 유럽여행

- Python

- 세계여행

- 백준

- 유럽

- 자바

- 리스트

- 스프링

- 기술면접

- 야경

- 남미

- a6000

- 세모

- 지지

- 알고리즘

- 맛집

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | |

| 7 | 8 | 9 | 10 | 11 | 12 | 13 |

| 14 | 15 | 16 | 17 | 18 | 19 | 20 |

| 21 | 22 | 23 | 24 | 25 | 26 | 27 |

| 28 | 29 | 30 | 31 |